О нейросетях наверняка лучше всего написали бы сами нейросети. И это не шутка. Но поскольку я все же не хочу пока платить за них, придется трудиться самому. Итак, что мы можем использовать сейчас и что ждет геймдев и моддинг в будущем в эпоху AI?

Предисловие от автора: названий будет много, ссылок мало, если вас что-то заинтересовало, найдется оно легко. Очень не хочется забивать текст горой линков, да и проверять, какие из них доступны сейчас у нас, а какие нет. Прошу прощения так же, что не разжевываю элементарного, текст длинный, разбавлять его водой в духе "что такое нейросеть" не хочется. Будет много видео. Приятного чтения!

М.В. Ломоносов

Открылась бездна, звезд полна

Звездам числа нет, бездне - дна.

нейромоддинг на марше

Начну с нашей любимой темы: собственно, моддинга. Ведь мы, можно сказать, собрались тут изначально ради модов. А для них нейросеть ElevenLabs AI успешно пишет озвучку:

- Озвучка Драконорожденного для Skyrim SE (англ.)

- Квест о Бабе Яге с генерированной озвучкой (текст русский, озвучка англ.)

- Озвучка Дагот Ура для Morrowind (англ.)

На самом деле это вовсе не первая попытка использовать в моддинге силу искусственного интеллекта. Мод Morrowind Enchanced Texures был сделан при помощи самообучающейся системы ESRGAN и получил звание лучшего графического мода еще в 2018 году.

Это только то, что касается модов для нашей горячо любимой TES, остальные игры так же улучшали при помощи AI, это, например, неофициальный ремастер Max Payne, Doom 2 и Resident Evil 4. Использовались инструменты Nvidia Gameworks и AI Gigapixel от Topaz Lab.

Алгоритм CycleGAN был использован для преобразования стиля одной игры в другую при помощи машинного обучения. Автор, работающий для DeepGamingAI, считает, что подобная технология очень полезна для будущего моддинга.

Нейросеть в реальном времени стилизует игру под другую игру

Сами разработчики не отстают: ремастер Mass Effect Legendary Edition был сделан при помощи апскейлинга текстур, произведенного AI. Более тридцати тысяч текстур увеличены примерно в четыре раза по сравнению с исходниками. Разумеется, не без вмешательства людей: некоторые шейдеры AI обработать не мог из-за слишком плохого качества в начале, и их пришлось переписывать.

Дело было в 21 году, а сейчас мир захлестнут волной нейросетей, и я предлагаю вам подумать вот о чем: а далеко ли до момента, когда AI начнет самостоятельно делать вполне качественные и крепкие игры (и моды. конечно)? Не без помощи людей, разумеется, ведь сети отвечают на запросы "кожаных мешков", и самостоятельно подобных желаний не проявляют. Пока.

может ли ai создать игру?

Никто, думаю, не удивится, что попытки создать игру, нажав на кнопочку "создать игру", будут сопровождать эксплуатацию нейросетей, пока у них не начнет получаться. И разумеется, такие попытки уже были.

Финн Юсси-Петтери Кемппайнен пытается сделать видеоигру, используя нейросети Midjourney и Stable Diffusion. Они генерируют изображения по текстовому описанию. База для игры создается при помощи Blender и Unity, а вот концепты, локации, текстуры и даже изображения персонажей генерирует AI. Для удобства такого сотрудничества Кемппайнен выбрал формат 2,5D.

Плоды совместного творчества.

Но у финна опыт в создании игр порядка 20 лет. Вопрос, что будет, если корованы погонять захочет простой юзер или человек с небольшим опытом? Что же, вот видео на русском языке, где автор пытается создать минимальнейшую игрушку на Roblox, используя мощный интеллект сети ChatGPT. Этой сети чуть ли не прочат судьбу убийцы Google, так как она выдает в результате поиска нормальную информацию, а не искусственно поднятые алгоритмами вверх бессмысленные сотни рекламных сайтов и копирайтерских текстов. Иными словами, найти, как именно написать скрипт, она, по идее, должна. Но пока что результат не очень.

Робот, сделай мне игру!

Уверен, рано или поздно сделать игру запросто будет делом недолгой возни. Но пока что рано говорить, что нейросети оставят всех без работы. Предлагаю пока что рассмотреть, что же мы можем сделать для игр в нейросетях?

нейросети работают с графикой (2D, 3D, видео)

Не умеете рисовать, моделировать и делать видео? Какая ерунда, скоро везде появятся знаменитые кнопочки "сделайте мне красиво", предмет стеба преподов графики над новичками. Стеб закончен!

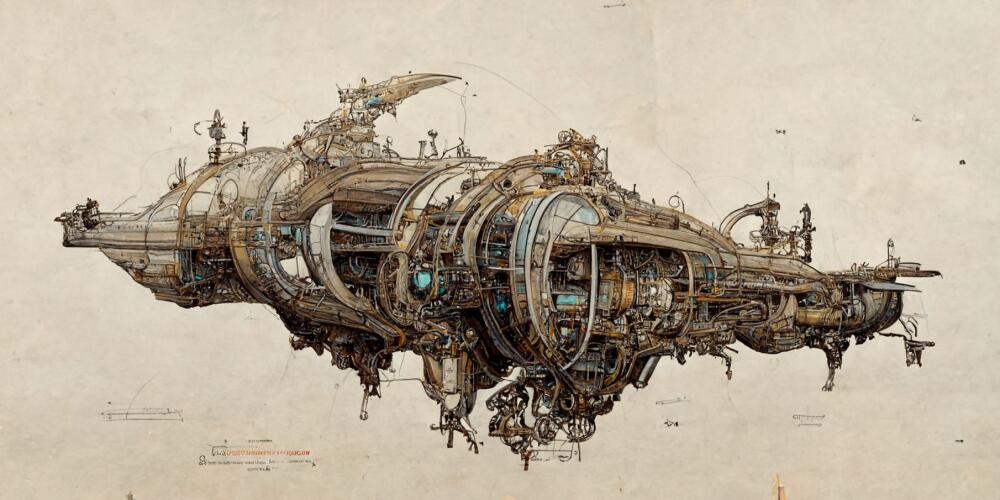

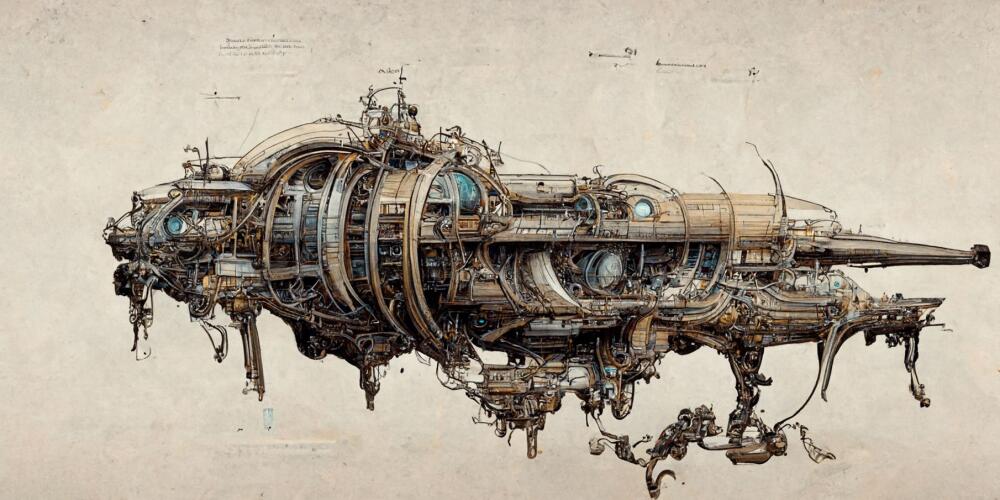

Кроме полезнейших профессиональных инструментов от NVIDIA и TopazLab, сетей множество, самую известную из них, Midjorney, я уже упомянул выше. Ее щупают и разработчики. Эрик Беллефьюлл - арт-директор Ubisoft Montréal - побаловался с сетью, чтобы получить изображения кораблей в стиле стимпанк, и вот что у него вышло:

Пока этот чертеж лишь концепт

Но концепт уже неплохой

Пока с этими чертежами ничего не сделаешь, они больше напоминают бессмысленное нагромождение деталей, но в этом есть какая-то чуждая красота. Главное для нейросетей - их способность обучаться с накоплением опыта. Быть может, однажды Эрик получит в результате роскошные и достойные чертежи.

С момента создания DALL-E в 2021 году (а я напомню, что это одна из первых сетей, генерирующих изображение по описанию), AI расплодился как грибы после дождя.

Нейросети:

- делают из портретов людей персонажа аниме: QQ Small World, скажем.

- рисуют картины, которые вы можете использовать, как арт: StarreAI, Pixray, Hotpot, ruDALL-E на основе самого первого генератора, обученного русскому языку, совсем уж чудящий абстрактный Dream на базе сетей Google и так далее.

- генерируют несуществующих людей, портреты, которые можно без опаски использовать в качестве референсов для персонажей: This Person Does Not Exist, (использующий разработанный компанией Nvidia алгоритм StyleGAN), Artbreeder (на базе StyleGAN и BigGAN) и т.п.

- генерируют фотореалистичное изображение из наброска: GauGAN от Nvidia.

- улучшают изображение: SuperResolution.

- делают из фотографий портреты: Lensa на основе Stable Diffusion.

- выделяют и удаляют объекты на фото: Instance segmentation, а еще смешной AI Replace My Ex, заменяющий бывшего на старом фото каким-нибудь левым объектом.

- преобразуют и стилизуют изображение: Style Transfer, Pix to Pix, Image-to-image, алгоритм CycleGAN

Это лишь несколько примеров. Разработчики игр и программ могут применять графические таланты нейросетей достаточно широко. Компания Adobe уже встроила сетку в Photoshop и Substance, улучшая алгоритмы обработки и выделения объектов, работы с тенями и текстурами.

Куда же без нее

Пощупайте и подружку

Далеко шагнули и видеотехнологии: от Deepfake, позволяющей имитировать на видео реальных людей (вы можете, скажем, понаблюдать за приключениями президентов в таких роликах на YouTube), до умения исправлять старые ролики, как это делают сети на основе уже упомянутой технологии GAN, например, DeepHD от Яндекса.

Яндекс так же научился переводить видео с английского и генерировать субтитры, так что вы наконец можете расшифровать англоязычное видео, которое не очень понимаете, да еще услышать его в русской озвучке. Проверял лично, очень здорово было смотреть старые ролики заново. Сейчас добавлена и возможность синхронного перевода для стримов. Нужен Яндекс.Браузер.

Сеть Waifu2x в десктопной версии увеличит разрешение. подавит шум и улучшит резкость видео. Доступна в России. Так же можно упомянуть куда более продвинутые Wisecut, Pixop, SuperSloMo, DVDFab Enlarger AI.

Но самое интересное - генерация видео по описанию. Это должна суметь находящаяся в разработке у Meta (запрещена в РФ) сеть Make A Video, которая пока что выдает нечто не очень внятное. Пока что китайская CogVideo справляется куда лучше с реалистичностью, но генерирует коротенькие маленькие ролики. И есть надежда на Imagen Video от комании Google, которая изо всех сил старается не отстать в разработке от остальных.

Немного подождем, и генерировать видео для игр собственной разработки будет уже намного проще.

GDFLab video upscaler увеличивает разрешение и размер видео

И конечно же, сети помогают в генерации 3D-моделей. Эти модели суть сетка, координаты точек, описывающие форму объекта, так что проблем с этим не должно было возникнуть - и не возникло. Как были программы-генераторы моделей, так и остались, зачем же тогда сети?

Конечно же, для генерации по описанию или плоской картинке. Те же авторы DALL-E создали сеть POINT-E, которая сначала генерирует изображение по описанию, а потом преобразует в трехмерный объект. Nvidia в соавторстве со Стэнфордом разработали сеть EG3D, генерирующую точные модели с двухмерного изображения, как и PiFUHD, Dream Fusion AI и так далее, список пополняется.

Именно здесь никаких особых проблем я не жду, разве что на первых порах все придется доделывать за тупыми роботами. Но ведь это дело времени. Есть и сети, которые помогают моделлерам по-другому. Скажем, занятная PoseNet анализирует движение человека, его суставы, скелет и ключевые точки, облегчая задачу этого анализа аниматорам. Сеть Vibe при этом еще генерирует точный силуэт. PRNet выполняет построение модели лица после сканирования. А нейронная сеть Occupancy Network не только генерирует объекты, но и улучшает существующие модели (правда, пока что простые).

Как уже стало ясно из этого материала, с графикой не будет особых заморочек. Если вы пожелаете делать концепты для игры - вы их сделаете. Портреты реалистичных персонажей не будут вызывать стеб, как над BioWare, где взяли первое попавшееся лицо из Google для проекта Andromeda. Текстуры, модели - все это в недалеком будущем почти перестанет вызывать заторы в работе. Но это еще не все, что нужно для игры.

Так что продолжение следует: в следующей части мы разберемся с музыкой, текстами и программированием! Поделитесь своим опытом столкновения с AI и нейросетями. Удалось сделать что-нибудь интересное?

-

24

24

Рекомендуемые комментарии

Для публикации сообщений создайте учётную запись или авторизуйтесь

Вы должны быть пользователем, чтобы оставить комментарий

Создать аккаунт

Зарегистрируйте новый аккаунт в нашем сообществе. Это очень просто!

Регистрация нового пользователяВойти

Уже есть аккаунт? Войти в систему.

Войти